Das Immersiv Lab ist ein Projekt des ICST an der Zürcher Hochschule der Künste. Es ist ein interaktives audiovisuelles Set-up, das Mehrkanal-Audio und visuelle Projektion im Panorama mit Touch Interaktion auf der gesamten Projektionsoberfläche integriert.

Das Set-up wurde von Daniel Bisig und Jahn Schacher entwickelt, und es wird Künstlern für experimentelle Medienprojekte zur Verfügung gestellt.

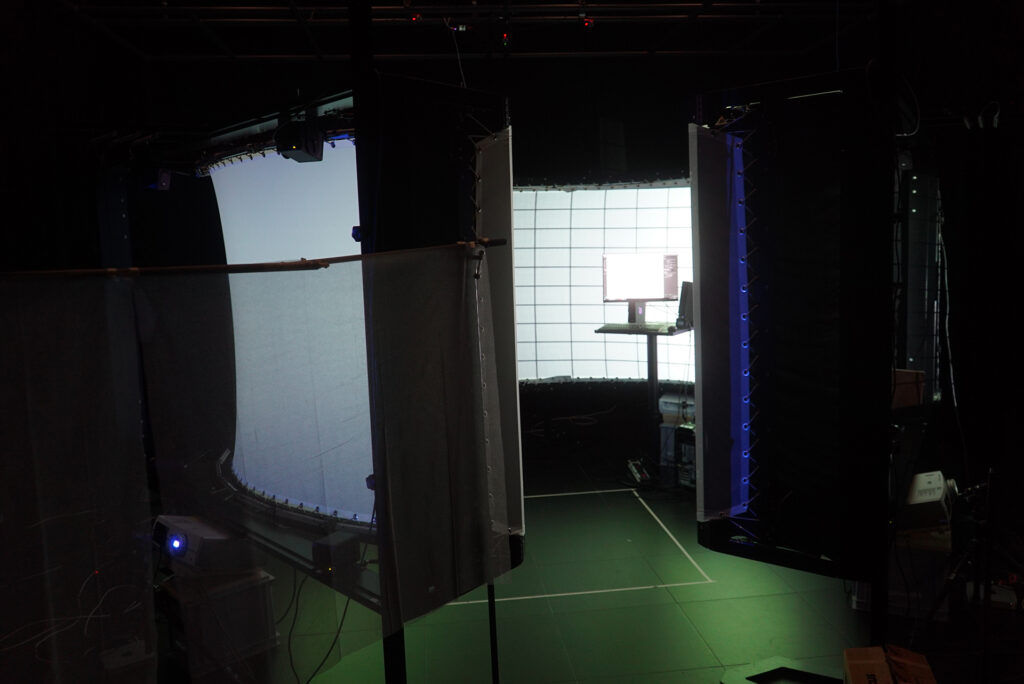

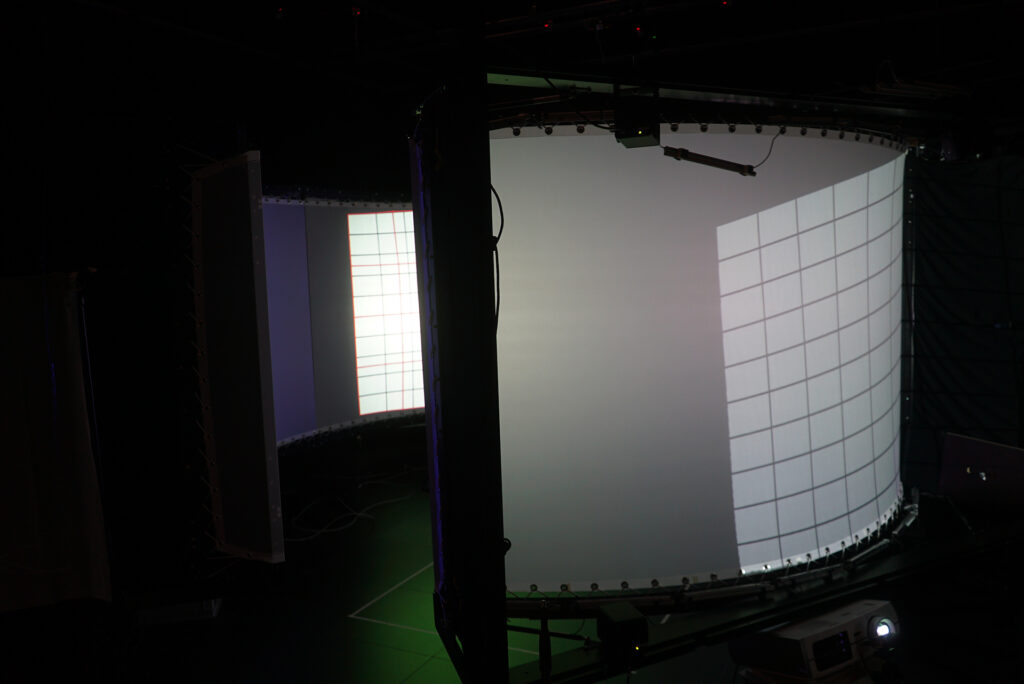

Das Set-up besteht aus einem mehrkanaliges Lautsprechersystem mit sechzehn Kanälen und zwei Subwoofer, sowie einer Bildprojektion mit vier Projektoren auf vier Leinwänden, die in einem Bogen um die Zuschauer angeordnet sind. Die Leinwände sind je 10,3 x 1,5 m gross. Es gibt eine Öffnung, durch die der Zuschauer in die kreisförmig angeordnete Installation eintreten kann. Der Durchmesser dieses Kreises mit über zwölf Meter bietet Platz für mehrere Personen.

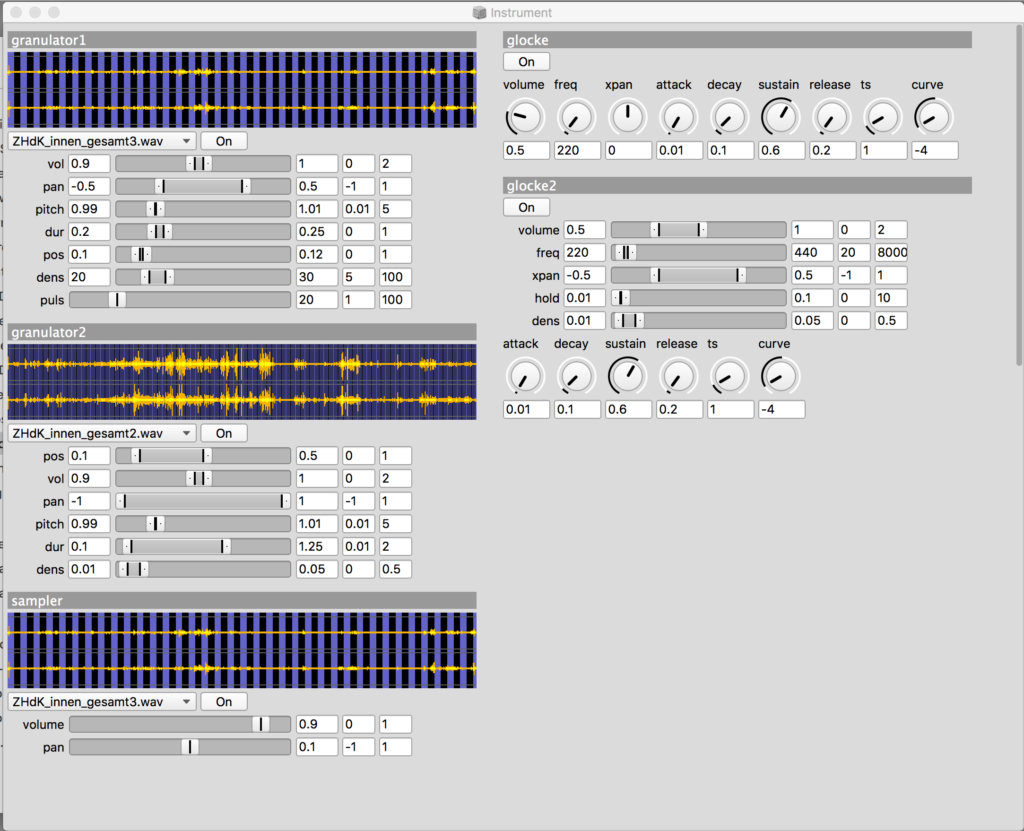

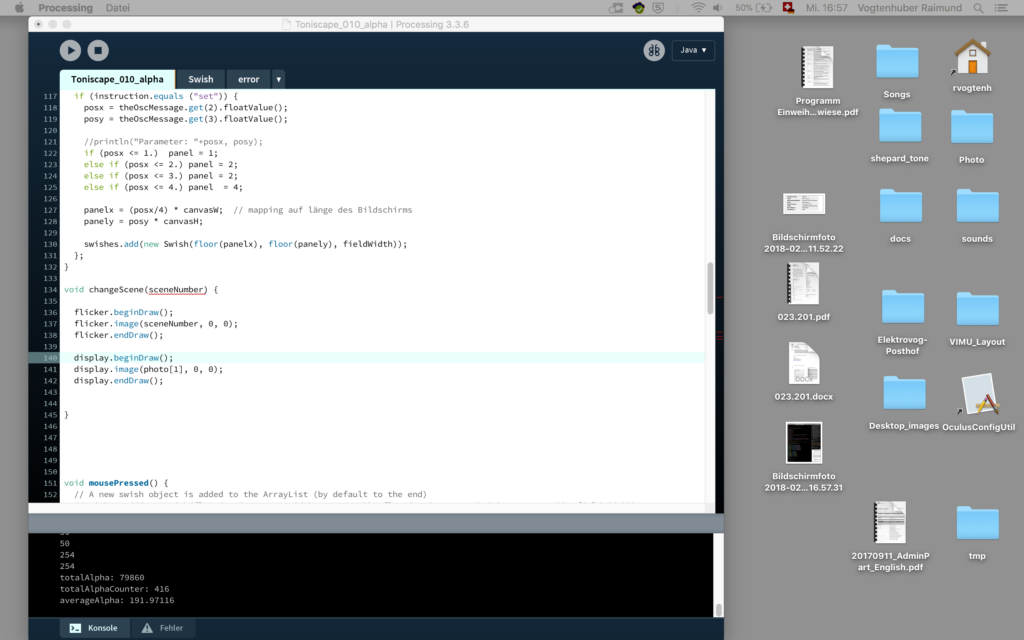

Die Berührungen auf der Leinwand werden mit Infrarotkameras gemessen. Diese Daten werden an einen im lokalen Netzwerk angeschlossenen Computer geschickt. Der Künstler kann die Parameter (die Positionsdaten der Berührung, die Beschleunigung der Bewegung) in den jeweiligen Stücken mit verschiedenen Audioprogrammen verarbeiten. Die Interaktion des Teilnehmenden mit der Leinwand kann in den Stücken gewisse kompositorische oder visuelle Vorgänge auslösen, je nach Programmierung der Stücke. Für das Set-up wurden einfache Templates in Audioprogrammen wie Max Msp und Supercollider sowie visuellen Programmierumgebungen wie Processing oder Open Framework entwickelt und den Künstlern zur Verfügung gestellt.

Technische Details

Die sechzehn Lautsprecher befinden sich jeweils an den Ecken der vier gebogenen Leinwände. Die Lautsprecher sind somit auf zwei vertikalen Ebenen regelmässig in einem Kreis angeordnet. Die Bildprojektoren sind auf Spiegel gerichtet, die so jeweils eine der vier Leinwände indirekt von aussen bestrahlen. Die Leuchtkraft der Projektoren ist gross genug, um ein hochauflösendes Bild pro Leinwand darstellen zu können. Der Raum der Installation ist abgedunkelt und eignet sich daher für immersive audiovisuelle Performance. Die Installation wird von einem zentralen Computer mit Video und Audio bespielt. Die Audioausgabe wird über eine mehrkanalige Soundkarte über einen Verstärker auf die sechzehn Lautsprecher verteilt.

Die Positionsdaten der Berührungen werden über vier kleinere Computer (Apple Mini) mithilfe von Infrarotkameras gemessen und berechnet und an einen Hauptcomputer mit dem OSC-Protokoll geschickt. Diese Daten können in verschiedenen Programmen verarbeitet werden. Diese Audio- und Videoprogrammierumgebungen können die Daten in den Prozess der Erzeugung der Klang- und Videoprojektion einbeziehen. Zwar gibt es die Möglichkeit, die Installation mit fixen Medien wie Videofilmen zu bespielen, jedoch bieten diese keine Möglichkeit auf die Interaktionen der Beteiligten zu reagieren. Für die Programmierung meines Stückes wählte ich Supercollider und Processing.